Видеокарта NVIDIA GeForce GTX 580

.jpg)

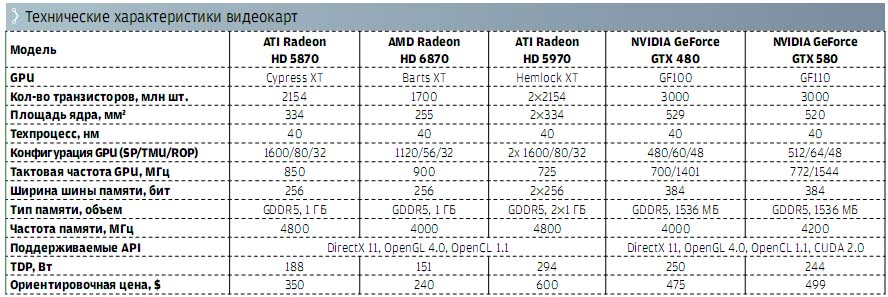

Выпущенная в марте, видеокарта NVIDIA GeForce GTX 580, была охарактеризована как самая быстрая, горячая и дорогая. Но конкурировать с ATI Radeon HD 5870 не имеет особого смысла, да, главное преимущество видеокарты заключается в быстродействии (15-20%), но высокая цена не оправдывает разницу. Существует ряд причин, которые подействовали на архитектуру Fermi. Одна из самых главных, это разработка архитектуры направленная на профессиональное пользование для сложных вычислений, приумноженная сложность, повлекла за собой увеличенное количество транзисторов в графическом процессоре, что привело к его увеличению, а это содействовало определенным производственным трудностям и увеличению стоимости, высокому энергопотреблению и тепловыделению. Но если рассматривать модель GeForce GTX 480 с точки зрения маркетинга, то она однозначно добилась высоких потребительских оценок, и считается самой быстрой видеокартой с одним чипом.

Сегодня компания производитель, выпускает новинку GTX 580, наследницу предыдущей модели, которая обещает зафиксировать успешность и устранить некоторые недостатки. При первом осмотре новинки, уже можно понять, что новая выпущенная модель, это доработанное старое поколение графики. Но это не упрек, например компания AMD поступила точно так же, когда выпустила под видом новых разработок, модернизированные и удешевленные модели видеокарт Radeon HD 6800. Так же для многих нынешних игр, производительности видеокарты вполне хватает, так что увеличение производительности актуально только для самых высоких разрешений и 3D Vision технологий, которые усиливают нагрузку на графический процессор. Как считают эксперты, в перспективе, количество игровых проектов, особенно ресурсоемких, будет уменьшено, а самые основные из них будут разрабатываться с упором на консоли, где быстродействие очень уступает ПК.

Архитектура

Новая видеокарта GeForce GTX 580, взяла за основу графический процессор GF110, который содержит 3 миллиарда транзисторов. Нужно отметить, что технологические линии полупроводниковой компании TSMC, которая выпускает графические процессоры для компаний NVIDIA и AMD, существенно улучшены, в вопросе энергопотребления и теплоотдачи, новый чип будет улучшен.

Процессор GF110 совмещает в себе однозначное строение предшествующей модели и обновления, которые удалось достигнуть на протяжении года. В отличие от предыдущей модели от GeForce GTX 480, в обновленном процессоре все блоки активны, они имеют 512 гибких и эффективных шейдерных процессоров, 64 текстурных блока и 16 устройств Polymoph Engine. Все прочие характеристики остались не тронутыми, это и 48 блоков растеризации, и кеш L2 768 КБ, и контролеры памяти 64 бит, которые формируют шину 384 бит, так же новинка комплектуется 1,5 ГБ памяти. Исходя из всего вышесказанного, создается впечатление, что новая видеокарта GTX 580 не так уж далеко ушла от бывшего лидера, но существуют и другие инновации. Одна из них, это увеличенные тактовые частоты, нынешний графический процессор работает на 772 МГц, а шрейдерный домен на 1544 МГЦ. Память увеличена до 1 ГГц.

Вторая и немаловажная инновация, включает в себя обновленные текстурные блоки, которые впервые появились еще на GTX 460. Их отличие заключается в двое увеличенном быстродействии, во время работ с текстурами FP16, которые применяют в современных играх, и это значит, что режим HDR обрабатывается на высокой скорости и при этом не теряет производительности. И наконец, еще одно важное усовершенствование, это переделанный алгоритм отсечения пикселов (Z-cull), с помощью которого можно более точно определять скрытые части сцены, извлекать их из обработки, при этом освобождая ресурсы. Производитель утверждает, что прирост данной операции составляет 8% ,что делает существенный вклад в производительность.

Работа над ошибками

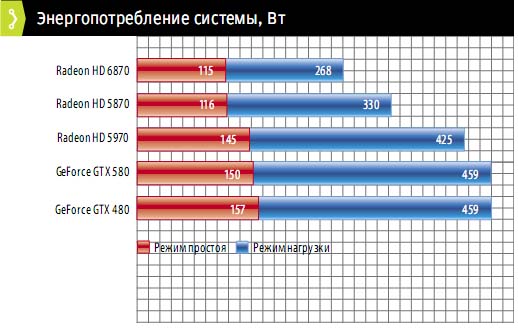

Естественно, что особое внимание производитель уделил особенностям Fermi, которые имели нарекания, т.е., потребление энергии, теплоотдача и шум. Абсолютно все блоки функциональные блоки GF110 спроектированы заново, с учетом всех изъянов, которые были обнаружены в блоках GF100, и теперь графический процессор имеет меньшую утечку тока, соответственно меньше нагревается. В процессе модернизации, изменилась и система питания, с точки зрения, как элементной базы, так и управления. Теперь в ее состав входит три датчика, которые измеряют ток, потребляемый видеокартой. Если драйвер замечает аномальную повышенность тока и использование утилит, то тактовые частоты снижаются, для сохранения заявленного уровня TDP.

Сравнивать с конкурентами, конечно не хорошо, но NVIDIA можно понять, очень высокие показатели потребления электроэнергии, определены с помощью утилит, а их, как известно многие не запускают, а нагрузка на видеокарту в современных играх не встречается вообще. Сегодня можно наблюдать, подобные ситуации с тепловыми пакетами центрального процессора, в понимании производителей AMD и Intel, AMD применяет показатель среднего потребления (ACP), а Intel применяет максимально допустимый TDP. Однако, нужно учесть, что этот алгоритм применяется только в вышеупомянутых приложениях.

Что касается системы охлаждения, то она значительно изменена, так вместо тепловых трубок, радиатор имеет большую камеру, которая расположена по всей площади его подошвы, и тонкого алюминиевого оребрения. Уже знакомый центробежный вентилятор, выдувает наружу горячий воздух. Так же модернизированы системы управления кулером и термоконтролем. Характерный резкий скачек скорости вентилятора и его шумности, уменьшается за счет плавного роста. В итоге, при максимальной нагрузке на видеокарту, шум отчетливо слышен, но это не мешает комфортной работе. Стоит так же учесть, что температурный режим значительно улучшился. GeForce GTX 580 даже при самой высокой нагрузке с выключенным алгоритмом снижения частот, не достигает даже 90 °С.

Результаты тестирования

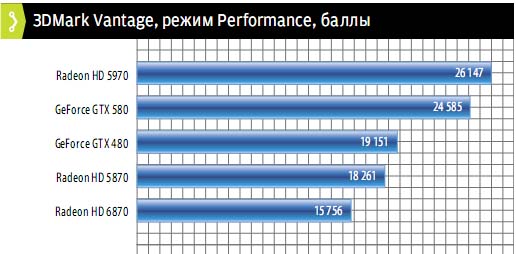

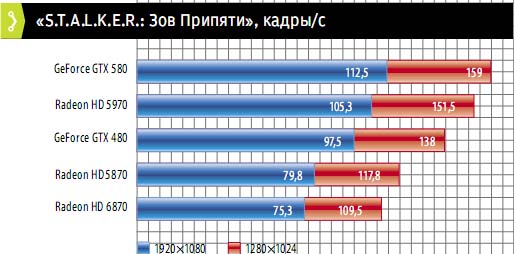

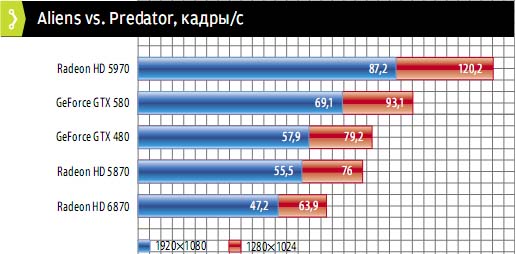

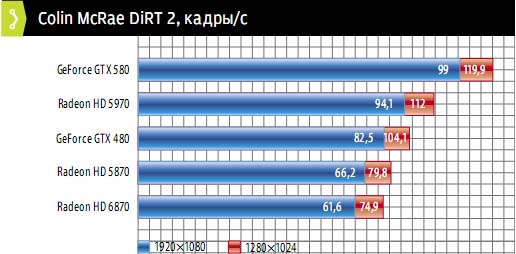

В процессе тестирования GTX 580, можно увидеть совокупность незначительных улучшений. Которые привели к существенному быстродействию видеокарты. Превосходство новой модели, заключается в большей производительности в текстурировании (11-28%), ускоренной тесселяции и увеличенных частотах. Если ранее речь шла о том, что GTX 480, является самой быстрой видеокартой с одним чипом, а двухпроцессорная видеокарта Radeon HD 5970, существенно ее опережает, то сейчас, можно смело заявить, что новинка от NVIDIA занимает все лидирующие позиции. В процессе проведения определенных тестов, видеокарта AMD превосходит показатели GTX 580, только в 3DMark Vantage и Aliens vs. Predator, а в остальных, новинка Fermi, с минимальным отрывом опережает видеокарту HD 5970, а если учитывать, что вышла только первая версия драйвера, то можно считать, что в дальнейшем, отрыв существенно увеличится. Нужно отметить, что в тяжелых играх, значительно уменьшилось потребление электроэнергии, эти показатели снизились на 30-35 Вт. В процессе наибольшей загрузки форсированного режима работ FurMark, при выключенном программном ограничении тока, GTX 580 имеет одинаковые показатели, схожие с предшествующей версией , и это привлекает к себе внимание приростом функциональных блоков и частотой оптимизации ядра и системы питания.

Выводы

Можно утвердить, что видеокарта NVIDIA GeForce GTX 580 это однозначный успех, наконец, в ней устранены все недостатки архитектуры, с ней удобно работать, она не производит шум, значительно меньше нагревается и потреблении энергии существенно снижено, а так же и она действительно быстродействующая. Конечно, рано говорить о свержении видеокарты Radeon HD 5970 с занимающего постамента, но ее производительность и производительность новинки находятся практически наравне, а если еще учесть удобство в использовании, то GeForce GTX 580 явно занимает высшие позиции. Пока сравнивать новинки производителей NVIDIA и AMD нет смысла, хоть видеокарты и имеют разницу в цене, но они так, же обладают большей разницей в производительности.